Sokan a mesterséges intelligenciát okolják azért, hogy az internet tele van hamis fotókkal és videókkal - pedig a helyzet az, hogy a web már eddig is tele volt olyan dolgokkal, amiknek köze nincs a valósághoz. A mesterséges intelligencia "csak" olaj volt a tűzre; egyrészt lényegében bárki számára gyorsan, kényelmesen és ingyen teszi lehetővé a deepfake tartalmak előállítását, másrészt ugrásszerűen javult a minőség. A képekről, videókról és hangfelvételekről egyre nehezebb eldönteni (sőt, sokszor már lehetetlen) azt, hogy valódiak, vagy csak egy ügyes prompt eredményeként születtek.

Mi azért megpróbálkozunk a lehetetlennel, és megmutatjuk, hogyan tudod eldönteni tökéletes biztonsággal minden fotóról, hogy igazi-e vagy sem. Spoiler: sehogy. 100%-os módszer nincs, pedig nemcsak AI-szolgáltatásból van egyre több, hanem az AI-t felismerő AI-szolgáltatásból is. De jó módszerek azért vannak; ezekkel elég nagy biztonsággal meg tudod állapítani, ha egy felvétel nem valódi. Már ha tényleg nem valódi. És ha nem tökéletes. És ha szánsz elég időt a vizsgálatra. És nem siklasz el az apró részletek felett.

Pornótól a politikáig

A www.thispersondoesnotexist.com egy olyan weboldal, amely minden betöltésnél előállít egy portréfotót nem létező személyekről. Ez az oldal 2019 óta létezik, jelenleg az Nvidia StyleGAN AI modelljét használja - de a site-nak voltak elődjei, amelyek akár már 15-20 évvel ezelőtt is valósághű arcképmásokat tudtak előállítani. A mesterséges intelligencia segítségével előállított fotókról a legtöbben viszont 2017-ben hallottak először, amikoris egy "jólelkű" Reddit felhasználó rájött arra, hogy az AI tökéletesen használható arra, hogy pornográf tartalmú képeken és videókon az eredeti szereplő arcát híres emberek arcára cserélje. Létre is hozott egy fórumot, hogy szabadon cserélgethesse a képeit másokkal. Józan ésszel persze azonnal belátható, hogy ez nincs rendben; a dolog mégis azt mutatja meg kiválóan, hogy a jogalkotás még ma is mennyire felkészületlenül áll világszinten is az újabb és újabb digitális technikai megoldások előtt. A pornó oldalak már 2018-ban elkezdték tiltani a deepfake tartalmakat, a világ országainak törvényhozói (vagyis inkább közülük néhányan) viszont jóval lassabban ébredtek, és csak évekkel később hoztak létre szabályozási keretet, ha egyáltalán. Apropó, deepfake. A deep learning (mély gépi tanulás) és a fake (hamis) kifejezésekből összeállt szó eredetileg csak az AI-val módosított pornóra vonatkozott, mára viszont lényegében minden, AI-val előállított tartalomra használatos kifejezéssé avanzsált.

A mesterséges intelligencia sok jó dologra használható - és még több rosszra. A pornó mellett a másik slágerterület a politika, ahol a valósnak tűnő felvételekkel próbálják a felek megtéveszteni a választókat vagy a közvéleményt. A repertoár széles: az amerikai választásokkal és az orosz-ukrán háborúval kapcsolatban például rengeteg deepfake felvétel került nyilvánosságra, és hát a helyzet az, hogy még csak nem is kell a szomszédba mennünk, jönnek azok szembe a Facebook magyar vonatkozású oldalainak hála is. A mesterséges intelligenciát a csalók is szeretik: nemcsak közel tökéletes leveleket lehet írni vele, hanem remekül utánozhatók vele hangok egy unokás csaláshoz, vagy akár arra is fel lehet a technológiát használni, hogy hamis hirdetések készüljenek híres emberekkel. És ez csak egy kis szelete a "lehetőségeknek", erről a felhasználásról külön cikkünkben részletesen olvashatsz. Mindennél fontosabb tehát, hogy megtanuljuk felismerni a hamis fotókat, a hamis videókat és a hamis hangfelvételeket.

Deepfake fényképek felismerése

A mesterséges intelligencia algoritmusok folyamatosan fejlődnek, ezért egyre jobb minőségű fényképeket állítanak elő, akár a semmiből is. Egy fotóról azonban nemcsak ezért nehéz megállapítani, hogy hamisítvány-e vagy sem, hanem azért is, mert az AI nemcsak teljesen új képek előállításához használható, hanem meglévő kép szerkesztésére akár prompt, akár minta alapján vagy úgy is, ha az eredményt több fotóból kell összeollózni.

Szerencsénkre (vagy bánatunkra) nemcsak azok az AI-platformok szaporodtak el gombamód, amikkel tartalmat lehet generálni, hanem azok is, amelyek segítenek felismerni, ha egy kép manipulált. Badarság lenne persze vakon bízni bennük; a helyzet kicsit olyan, mint amikor egy harmadikos tanuló ellenőrzi, hogy az osztálytársa jól írta-e fel a másodfokú egyenlet megoldóképletét.

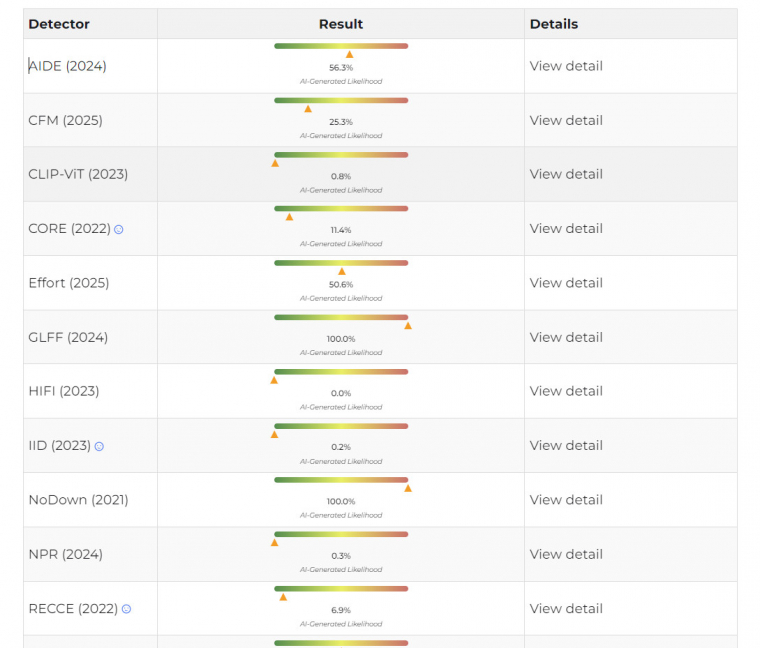

Azért adjunk egy esélyt a dolognak: a Deepfake-o-Metert a Buffalo Egyetem munkatársai fejlesztették ki. Ez egy olyan motor, amely tizennégy algoritmus segítségével vizsgálja meg a fájlt, majd százalékban kifejezett véleményt mond a fotóról, videóról vagy hangról. A megbízhatóságról viszont mindent elmond, hogy egy biztosan AI-val készült arcképről mindössze kettő algoritmus mondta azt, hogy biztosan AI, öt szerint viszont biztosan valódi, a maradék hét vizsgálat pedig 10-50 százalék közé tette annak esélyét, hogy deepfake felvételről van szó. Egyébként ez egy kredit alapon működő szolgáltatás, ingyen 30 fotó ellenőrizhető vele.

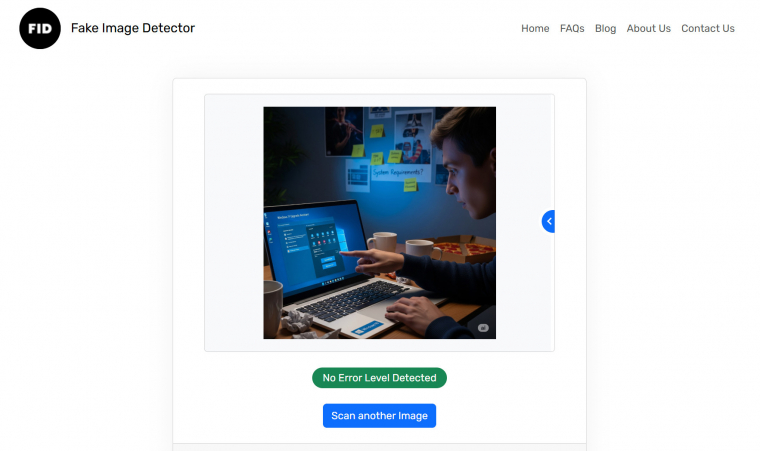

Visszatérve a hatékonyságra, a helyzet az, hogy a tesztfotó tényleg nagyon jól sikerült, a Fakeimagedetector és az imgdetector.ai sem talált kivetnivalót benne. Szabad szemmel és aprólékosan megvizsgálva a képet sincs rajta olyan részlet, ami egyértelműen azt jelezné, hogy a kép deepfake - de szerencsére sokszor azért vannak leleplező momentumok.

Lehet egy ujjal több? Vagy kevesebb?

Az alcímválasztás nem véletlen, az AI híres arról, hogy az ujjak számát nem mindig találja el. Persze nem arról van szó, hogy a generatív AI ne tudná, hogy egy embernek öt ujja van - sokszor azonban a kontextus miatt úgy gondolja, hogy egy vagy két ujj takarásban van, máskor pedig két ujjat egynek gondol, ezért alkot még egy hatodikat is. Túl sok fog, hiányzó, vagy tulajdonossal nem rendelkező végtagok - mind-mind olyan helyzet, amikor emberi aggyal pillanatok alatt észrevehető, hogy valami nem klappol!

Nem túlzás tehát azt állítani, hogy minden a részletekben rejlik.

Ezeket a részleteket azonban sokszor tényleg nagyon alaposan kell tanulmányoznod: előfordulhat akár olyan helyzet is, hogy csak egyetlen picike árnyékon csúszik el a dolog. Mi tudjuk, hogy kör alakú szemüvegkeretnek nem lesz téglalap alakú árnyéka, az AI néha mégis bepróbálkozik ilyennel. Gondok adódhatnak a rétegekkel is; Ferenc pápa pufidzsekis képe például bejárta a netet: a keresztet tartó láncnak az egyik fele hiányzik, a jobb kéz úgy vesz ki valamit a zsebből, hogy nem is fogja azt, de vicces a félig napszemüveg, félig normál szemüveg kombó is.

Erről a fotóról azonban akkor is gyaníthatnánk, hogy AI készítette, ha a fenti részletek mind klappolnának. Merthogy rengeteg esetben nem az apró hibák, hanem a kontextus a jel: láttál már pápát pufi kabátban? Kontextusbeli hibának számít az is, ha egy arc részletei rendben vannak, de az eredmény túl tökéletes vagy éppen ellenkezőleg, túl aszimmetrikus (például eltérő fülméret stb.) Noha nincs olyan arc, amelynek két oldala tökéletes tükörképei lennének egymásnak, az eltérés mértéke, ha túl nagy, gyanakodásra adhat okot. Még mindig ez a kategória, ha egy hölgy két fülében más a fülbevaló, vagy esetleg a ruhán nem egyformák a gombok.

Sokszor leplezi le az AI fényképeket az is, ha a világítás nem megfelelő: ha például az árnyékok vagy tárgyak fényes felülete nem ugyanabba az irányba esik, az egy nyomós oka arra, hogy a deepfake irányába billenjen a mérleg nyelve. Mint ahogyan az is, ha a háttérben lévő elemek ismétlődnek.

Gyakori hibája az AI-nak az is, hogy a fókuszban lévő témát nagyon jól kidolgozza, a háttér viszont elnagyolt vagy túlságosan torz. A megfelelő "rétegsorrenddel" is akadhatnak gondok: az AI a szimulált bokeh hatást aszerint állítja be, hogy a képen szereplő tárgyak milyen messze vannak, ám nem mindig sikerül jól belőni az egymáshoz viszonyított távolságokat. Ez a hiba átmenet a kontextusbeli és a technológiai hiba között; hogy utóbbira is mondjunk egy példát, az AI tudja, hogy a fotók minősége nem tökéletes. Ezért zajt is elhelyez a fotókon. Viszont sokszor alakul úgy, hogy a kép egyes részei durván zajosak, más részeken viszont nagyon enyhe ez a jelenség. A fentebb említett hatékonysággal az a helyzet az, hogy a tesztfotó tényleg jól sikerült, a Fakeimagedetector és az imgdetector.ai legnagyobb részben a zajszint elemzésével próbálják megállapítani, hogy egy fotó valós-e.

Videók: egy fokkal nagyobb falat

Noha a józan ész alapján a fotók felismeréséhez adott szempontok jó kiindulási alapot jelentenek videók esetében is, a helyzet kicsit árnyaltabb és bonyolultabb. Egész egyszerűen azért, mert a videók jellemzően alacsonyabb felbontásúak, és mivel veszteségesen tömörítik őket (ráadásul duplán, hiszen egyszer a feldolgozásnál, egyszer pedig a feltöltésnél), egy-egy képhiba esetén sosem lehet teljes biztonsággal azt mondani, hogy tartalmi vagy tömörítési gikszerről van szó. Nehezebb megállapítani az irányokkal kapcsolatos problémákat is, hiszen minden mozog. Ha szeretnéd meglesni, hogy mit tud az AI, akkor érdemes rákeresni a Youtube-on arra, hogy "Sora generated video" - a Sora az OpenAI által fejlesztett videogenerátor AI.

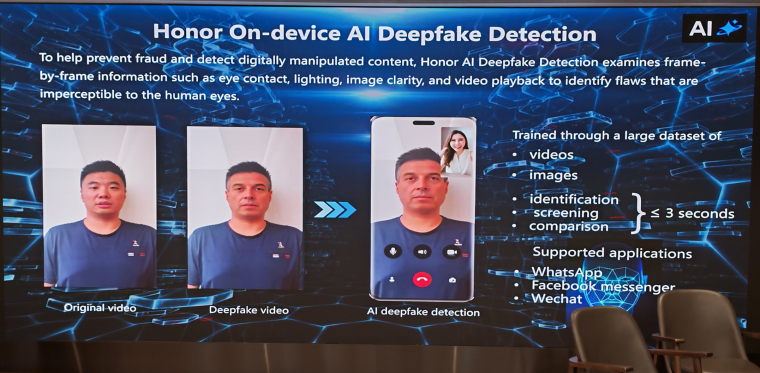

Természetesen videókhoz is van AI detektor szolgáltatás, például a Deepware.ai és a Hive AI Detector. Előbbihez nem sikerült olyan videót feltölteni, amire azt mondta volna, hogy AI, utóbbi viszont egészen nagy hatásfokkal dolgozott. Érdekesség, hogy a Honor okostelefonjai képesek arra, hogy videótefonálás esetén észleljék, ha nem élő személlyel beszélünk, hanem deepfake videóval.

Fizikából egyes

Amin a videók a leggyakrabban elbuknak, az a fizika - és itt nemcsak a háttérben lebegő tárgyakra kell gondolni, hanem lényegében bármire, ami mozog. A sétáló emberek mozgása épp úgy tökéletlen, mint az "autónkat" megelőző busz rugózása, illetve sokszor a kamerabeállítás is szokatlan perspektívát ad. Gyanakodásra adhat még okot, ha a szereplők szájmozgása és a hallható hangok nincsenek szinkronban, ha nem pislognak az alanyok. Illetve gyakori "hiba" még az is, hogy a videóban a közel, valamint a távol lévő részek kidolgozottsága között túl nagy az eltérés. Gondolunk itt arra, amikor a közelben minden szuperrészletes, a háttér viszont elnagyolt (vagy ismétlődő elemekből áll össze).

Hangfelvételek felismerése

A képek, a videók és a hang közül talán a hang felismerése a legnehezebb; mindössze pár másodperces mintára van szüksége az AI-nak ahhoz, hogy bármilyen szöveget fel tudjon olvasni. A felvételek minősége jellemzően nem tökéletes, a veszély abból adódik, hogy nincs vizuális megerősítés, csak a fülre lehet hagyatkozni.

Az AI annyira tökéletesen utánozza a hangszínt, hogy pusztán ennek alapján egyáltalán nem biztos, hogy felismerhető a deepfake - viszont a monotonitás, az érzelmek és a reakció hiánya árulkodó jel lehet, mint ahogyan az is, ha a háttérhangok és a beszélgetőpartner hangerősségei nincsenek szinkronban egymással.

Összegzés

Elborítanak minket az AI fotók, az AI videók és az AI hangfelvételek - megbízható technológia pedig nincs felismerésükre, ezért az apró jeleket kell figyelned, ha nem szeretnéd, hogy a multimédiás tartalmakkal manipulálják a tudatodat.