A PC-játékos közösségről elmondható, hogy technikailag felkészült és adatvezérelt, mégis meglepően sok leegyszerűsített dogma él a köztudatban a hardverekkel kapcsolatban. A legmagasabb GHz, a legtöbb mag, vagy korlátlan GB - mintha a teljesítmény egyetlen szám mentén mérhető lenne. A modern PC-s platformok dinamikusan szabályozott rendszerek, ahol az architektúra, az algoritmusok és a komponensek közötti egyensúly legalább olyan fontos, mint a specifikációs táblázat.

A számok iránti vonzalmunk érthető. A webshopok és gyártói adatlapok világában a legnagyobb értékek ösztönösen erősebbnek, jobbnak, "jövőbiztosabbnak" tüntetik fel az adott hardvert. A probléma nem azzal van, hogy ezek a számok esetleg hamisak, hanem az, hogy kontextus nélkül eléggé félrevezetők. A modern CPU és GPU már nem fix frekvencián üzemelő, kötött működésű eszköz, hanem folyamatosan alkalmazkodó, hőmérséklet-, terhelés- és energiafüggő komponens. A teljesítmény tehát nem egy paraméterre épül fel, hanem apró részegységek harmonikus tánca.

Felejtsd el a GHz-őrületet!

A processzorok világában a legősibb mítosz az órajel mindenhatósága. A gigahertz érték évtizedekig a teljesítmény első számú mércéje volt, és sok felhasználó fejében mind a mai napig ez tényként van elraktározva. A valóság azonban az, hogy az órajel csak az egyik fele az egyenletnek. A másik fele az IPC, vagyis az egy órajelciklus alatt végrehajtható utasítások száma. Egy modern mikroarchitektúra szélesebb végrehajtóegységekkel, fejlettebb elágazásbecsléssel és hatékonyabb ütemezéssel jóval több munkát képes elvégezni ugyanannyi idő alatt, mint egy-egy korábbi generáció. Ezért fordulhat elő, hogy egy alacsonyabb frekvencián működő, de újabb architektúrájú CPU játékban gyorsabb, mint egy magasabb GHz-re képes elődje - akár azonos magszám mellett is.

A valóság azonban még ennél is árnyaltabb, hiszen a gyorsítótár-hierarchia szerepe gyakran láthatatlan marad a felhasználók számára. Az L1 és L2 cache az azonnali adatelérést biztosítja, az L3 pedig egyfajta köztes pufferként működik a rendszermemória előtt. Ha a játék által használt adatállomány jelentős része elfér a gyorsítótárban, a processzor sokkal ritkábban kényszerül a nagyságrendekkel lassabb DRAM megszólítására. Ez közvetlenül javítja a minimális fps-értékeket és csökkenti a mikroakadásokat. Nem véletlen, hogy a nagyobb L3 gyorsítótárral szerelt modellek bizonyos címekben látványos előnyt mutatnak még akkor is, ha papíron alacsonyabb az órajelük.

Játékra ne 32-magos CPU-t válassz!

A magszám körüli számháború hasonlóan félreértelmezett terület. A "több mag = több fps" képlet első ránézésre logikusnak tűnik, ám a játékmotorok párhuzamosíthatósága közel sem végtelen. A renderelési futószalag egyes szakaszai egymásra épülnek, a fizikai számítások és AI-rutinok bizonyos részei pedig nem oszthatók tetszőleges számú szálra. A gyakorlat azt mutatja, hogy a legtöbb mai játék hat-nyolc fizikai mag felett már csökkenő futási hatékonyságot produkál. A magas magszám inkább multitasking esetén, tartalomkészítésnél vagy streamelésnél jelent előnyt, nem pedig tisztán játék alatt.

A modern processzorok ráadásul nem fix frekvencián működnek. A boost algoritmusok a rendelkezésre álló teljesítménykeretből gazdálkodnak, figyelembe véve a hőmérsékletet és az áramfelvételt. Ha csak néhány mag aktív, az algoritmus képes ezeket magasabb frekvenciára emelni. Ha minden mag le van terhelve valamennyire, a rendszer kénytelen szétosztani a rendelkezésre álló energiátkvótát, ami alacsonyabb egyedi órajelet eredményez. Ez az oka annak, hogy egy kevesebb, de erősebb maggal rendelkező CPU sokszor jobb játékélményt nyújt, mint egy sokmagos workstation-modell.

Ne a dobozra írt memóriaméretre figyelj!

A videokártyák esetében a VRAM kapacitása körül alakult ki talán a leglátványosabb és leghevesebb vita az elmúlt években. A közbeszédben a memória mérete gyakran egyenlő a kártya "erejével", pedig a grafikus teljesítmény elsődleges meghatározója továbbra is a GPU architektúrája: a feldolgozóegységek száma és felépítése, az órajel, valamint a memória-alrendszer effektív sávszélessége. A shader-tömbök, a textúrázó és raszterizáló egységek, a render-háttérrendszerek és a gyorsítótár-hierarchia együttese határozza meg, hogy a grafikus kártya adott időegység alatt mennyi műveletet képes elvégezni. A VRAM ezzel szemben nem számítási, hanem adattárolási kapacitás: gyakorlatilag egy nagy sebességű puffer, amely a GPU számára közvetlenül elérhető adatokat - textúrákat, geometriai adatokat, árnyéktérképeket stb.- tartja készenlétben.

Teljesítmény szempontjából kulcsfontosságú a memória-sávszélesség és a késleltetés is. Egy 192 bit széles buszon működő, magas órajelű GDDR7 memória más karakterisztikával rendelkezik, mint egy szélesebb buszra épülő, de alacsonyabb effektív frekvenciájú megoldás. A modern GPU-k ráadásul egyre nagyobb belső gyorsítótárakkal - például több MB-nyi L2 cache-sel - igyekeznek csökkenteni a külső memóriaforgalmat, ezzel javítva az effektív sávszélességet és az energiahatékonyságot. Ha a grafikus lapka számítási ereje nem képes elegendő adatot feldolgozni, a több VRAM önmagában nem jelent előnyt, mert a szűk keresztmetszet nem a kapacitás, hanem a feldolgozási teljesítmény.

Az elmúlt időszakban egyre gyakrabban fordul elő az az eset, amikor a játék memóriaigénye meghaladja a rendelkezésre álló VRAM-kapacitást. Ilyenkor a grafikus driver és az operációs rendszer memória-menedzsmentje kénytelen adatokat mozgatni a GPU dedikált memóriája és a rendszermemória között. Ez a folyamat a PCI Express csatolón keresztül történik, amely bár nagy sávszélességű, késleltetésben és hatékonyságban messze elmarad a közvetlenül csatlakoztatott, fedélzeti GDDR memória elérésétől. Amikor a GPU nem találja meg azonnal a szükséges textúrát vagy erőforrást a saját memóriájában, várakoznia kell, amíg az adat megérkezik a rendszermemóriából, ami ciklusokat vesz el a tényleges renderelési munkától. Ez a jelenség nem feltétlenül az átlag fps-érték drámai esésében jelenik meg, hanem hirtelen, szabálytalan frametime-ugrások formájában.

200+ fps-ed van, mi baj lehet?

Itt válik különösen fontossá a frametime és az átlag fps közötti különbség megértése. Utóbbi egy összesített érték: megmutatja, hogy egy adott időszak alatt hány képkocka készült el másodpercenként átlagosan. Ezzel szemben a frametime azt mutatja meg, hogy az egyes képkockák milyen időközönként érkeznek. Egy 60 fps-es átlag mögött állhat stabil, 16,6 milliszekundumos képkocka-idő, de állhat olyan sorozat is, ahol néhány frame 5-6 milliszekundum alatt elkészül, majd egy-egy képkocka 40-50 milliszekundumot késik. A játékos ilyenkor akadozást, "micro stuttert" érzékel, még akkor is, ha az átlag fps statisztikailag rendben van.

A VRAM-hiány tipikusan az 1% low és 0,1% low értékek romlásában jelentkezik először. Ezek a mutatók a leglassabb képkockák átlagát reprezentálják, és sokkal jobban korrelálnak a szubjektív játékélménnyel, mint a teljes mérési időre vonatkoztatott átlagos fps-szám.

Hasonló mintázat figyelhető meg memória-sávszélességi korlát esetén is: ha a GPU számítási egységei gyorsabban dolgoznának, mint ahogy az adat eljut hozzájuk, a grafikus futószalagok bizonyos részei üresjáratba kerülnek. Ilyenkor nem a VRAM kapacitása a probléma, hanem az adatáramlás üteme.

A helyzetet tovább bonyolítja a felbontás és a grafikai beállítások kérdése. Magasabb felbontáson az ún. frame buffer mérete és a textúra-igény exponenciálisan nő, miközben a GPU számítási terhelése is emelkedik. Előfordulhat, hogy egy adott kártya VRAM-kapacitása papíron elegendő lenne 4K-felbontáshoz, de a shader teljesítmény már nem képes fenntartani az elfogadható fps-t, így a memória többlete kihasználatlan marad. Ezért láthatsz gyakran olyan modelleket a boltok polcain, ahol egy középkategóriás grafikus chipet nagy kapacitású memóriával párosítanak: marketing szempontból vonzó kombináció, de a valós játékbeli haszon korlátozott.

Ha gyors az SSD-d, akkor a játékok is gyorsulnak - csak nem úgy

Az adattárolás és a rendszermemória területén is kialakult néhány olyan mítosz, amelyet elsősorban a specifikációs számok és a marketinggrafikonok táplálnak. Az egyik leggyakoribb gamer-tévhitet így lehetne összefoglalni: "Minél gyorsabb az SSD, annál jobban száguld a játék". A több ezer MB/s szekvenciális olvasási sebesség valóban látványos adat, különösen akkor, ha egy régi SATA-s meghajtóhoz hasonlítod. A probléma az, hogy a játék közbeni képkockaszámot nem a háttértár teljesítménye határozza meg.

A modern NVMe SSD-k PCI Express csatolón keresztül, több szálon és alacsony késleltetéssel működnek, ami rendkívül gyors adatátvitelt tesz lehetővé. Ez azonban elsősorban a betöltési időkre, a pályaváltások gyorsaságára és az operációs rendszer reakciókészségére van hatással. A játékmenet közbeni fps-t továbbra is a CPU és a GPU számítási kapacitása szabja meg. Ha egy jelenet renderelése 12 milliszekundumot vesz igénybe, azon az SSD sebessége nem változtat, mert a grafikus futószalag a szűk keresztmetszet, nem az adattárolás.

Egy másik elterjedt félreértés szerint az NVMe meghajtók "kiszolgálják" a GPU-t, ezért közvetlen teljesítménynövekedést hoznak. A valóságban a háttértár csak akkor válik kritikus tényezővé, amikor nagy mennyiségű adatot kell dinamikusan betölteni: például nyílt világú játékok textúra-streamingje során. Ilyenkor a gyorsabb meghajtó csökkentheti a betöltési mikroakadásokat, de nem azért, mert több képkockát számol ki a GPU, hanem mert kevesebb időt tölt várakozással az erőforrásokra.

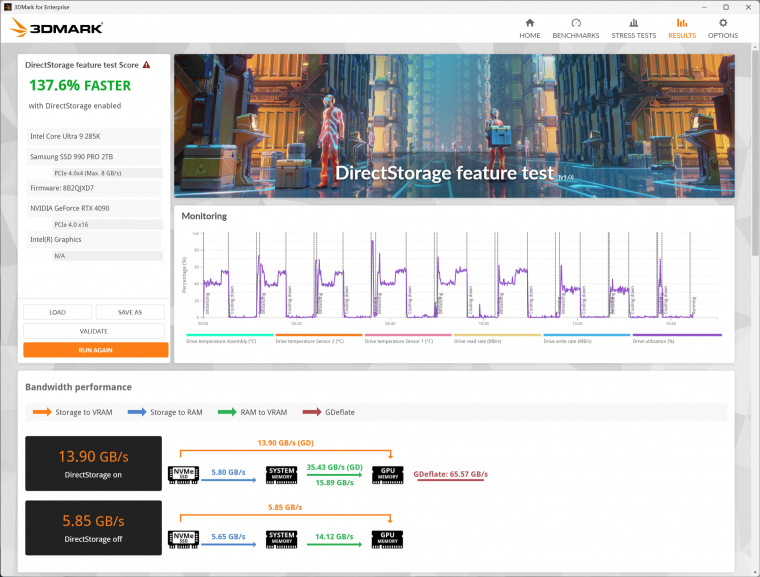

A DirectStorage technológia valóban képes arra, hogy a képi elemek kitömörítésének egy részét a GPU-ra terhelje, csökkentve a CPU túlterhelését, de ez sem univerzális fps-növelő eszköz. Ha a grafikus chip számítási oldalon már a teljesítménye határán dolgozik, a gyorsabb háttértár nem teszi erősebbé. Az egészet tovább bonyolítja, hogy a Microsoft évek óta nem képes áttörést elérni a DirectStorage szabvány területén, a technológia támogatottsága és hatása messze elmarad a beígért szinttől.

A több RAM nagyobb tempó, kevesebb várakozás

Hasonló leegyszerűsítés figyelhető meg a rendszermemóriával kapcsolatban is. A "minél több RAM, annál gyorsabb a gép" gondolatmenet elsőre logikusnak tűnik, de a valóság természetesen árnyaltabb. A kapacitás valóban kritikus tényező addig a pontig, amíg a rendszer és a játék bele nem fér a rendelkezésre álló memóriába. Ha azonban a szükséges adatcsomag kényelmesen elfér 16 vagy 32 GB-on, a további bővítés nem eredményez nagyobb sebességet. A memória nem számításokat végző egység, hanem adattároló. Ha nem jelent szűk keresztmetszetet, a teljesítmény más komponenseken múlik.

Ahogy arról korábbi cikkünkben írtunk, sokkal fontosabb tényező a memória konfigurációja és késleltetése. Egyetlen modul használata single channel módban gyakorlatilag felezi a rendelkezésre álló sávszélességet, hiszen a memória-vezérlő csak egy adatcsatornán kommunikál. Integrált grafikus vezérlő esetén ez drámai teljesítményvesztést okoz, mivel a GPU a rendszermemóriát használja videomemóriaként. Diszkrét GPU mellett a hatás kevésbé látványos, de CPU-limitált jelenetekben, alacsonyabb felbontásokon és magas frissítési frekvencián mérhető különbséget okozhat, különösen az 1% low értékekben.

A memória késleltetése és effektív sávszélessége szintén fontosabb lehet, mint a puszta kapacitás. A magasabb frekvenciájú, szorosabb időzítésű modulok csökkenthetik az adat-hozzáférési késleltetést, ami javíthatja a CPU és a memória közötti adatáramlás hatékonyságát. Ez különösen olyan jelenetekben jelentkezik, ahol a processzor gyors egymásutánban, nagy mennyiségű adatot mozgat. Ezt nem feltétlenül magasabb átlag fps-ben látod viszont, hanem stabilabb frametime-ban és kevésbé ingadozó minimum értékekben.

Inkább ne égj be a tápoddal

A tápegységgel kapcsolatban az egyik legmakacsabb gamer tévhit az, hogy "ha papíron elég nagy a Watt, akkor minden rendben". Ez a gondolkodás abból az időből maradt ránk, amikor a fogyasztás viszonylag egyenletesen terhelte a PC-ket. A modern videokártyák azonban egy ideje teljesen másképp működnek. A GPU boost algoritmusai a jelenet komplexitásának függvényében ezredmásodpercek alatt képesek jelentős fogyasztási ugrásokat produkálni. Ezek a rövid idejű, de extrém terhelési tüskék jelentősen meghaladhatják az átlagos fogyasztási értéket. Egy gyengébb minőségű tápegység hiába rendelkezik papíron elegendő névleges teljesítménnyel, ha nem képes megfelelően reagálni ezekre a gyors változásokra, a feszültségszabályozás instabillá válhat. Ilyenkor a rendszer védelmi mechanizmusai lépnek életbe, és a gép leáll vagy újraindul; miközben ott állsz értetlenül a jelenség előtt, hiszen "a Watt elég volt".

Hasonlóan leegyszerűsített nézet, hogy a tápegység nincs hatással a teljesítményre. Valójában a stabil és gyors feszültségszabályozás alapfeltétele annak, hogy a GPU és a CPU képes legyen tartani a boost-frekvenciát. Ha az energiaellátás nem stabil, a rendszer visszafoghatja az órajelet, hogy elkerülje az instabil működést. A táp tehát nem gyorsítja a rendszert, de képes korlátozni azt.

"Csak vásárold össze mindenből a legjobbat és tuti lesz!" Nem éppen...

A gamerközösség egyik legkitartóbb mítosza talán a "jövőbiztos" konfigurációba vetett hit. Az elképzelés csábító: ha ma megveszed a legnagyobb számokat felvonultató hardvert, évekre előre bebiztosíthatod magadat. A valóság azonban ennél jóval prózaibb. A technológiai ciklusok gyorsulnak, az új API-k, renderelési technikák és motoroptimalizálások más jellegű terhelést helyeznek a rendszerre, mint amire a korábbi generációk készültek. Ami ma túlméretezettnek tűnik, az holnap lehet, hogy nem ott és nem úgy jelent előnyt, ahol várnád.

A "future-proof" gondolat sokszor ugyanarra a leegyszerűsítésre épül, mint a GHz-, VRAM- vagy Watt-mítosz: minél nagyobb számot választasz, annál hosszabb ideig marad versenyképes a konfigod. A gyakorlatban azonban nem a legnagyobb paraméter, hanem a komponensek közötti arány számít. Egy kiegyensúlyozatlan konfiguráció, például extrém erős GPU középkategóriás CPU mellett, vagy fordítva, nem lesz jövőállóbb attól, hogy egyetlen eleme kiemelkedő. A szűk keresztmetszet mindig ott jelenik meg, ahol a rendszer leggyengébb pontja található.

Verd ki a fejedből a mítoszokat!

A hardverek adatlapja tehát nem hazudik, csak leegyszerűsít. A specifikációk valós adatokat mutatnak, de nem beszélnek az architektúra hatékonyságáról, a gyorsítótár-hierarchiáról, a boost algoritmusok dinamikájáról, a memória késleltetéséről vagy az energiaellátás stabilitásáról. Márpedig a játékélmény ezeknek az összetevőknek az együttműködéséből születik meg.

A "több = jobb" gondolkodás csábító, mert egyszerű. De a teljesítmény nem lineáris skálán mozog, és nem egyetlen szám mentén dől el. A valódi előnyt nem a legmagasabb GHz, a legtöbb VRAM vagy a legnagyobb Watt-érték adja, hanem az, ha a rendszer kiegyensúlyozott, és egyik elem sem válik szűk keresztmetszetté. A gamer szakértelem ma már nem abban rejlik, hogy felismerd a legnagyobb számot a táblázatban, hanem abban, hogy értsd: a számok mögött hogyan működik a rendszer egésze. És ez az a pont, ahol a mítoszok véget érnek, és elkezdődik a tudatos PC-építés.