A PC-k történetét végignézve jól látszik, hogy időről időre megjelennek olyan hardveres fordulópontok, amelyek nem egyszerűen nagyobb teljesítményt hoznak, hanem teljesen újraértelmezik azt, mire használjuk és használhatjuk gépeinket. Ilyen volt a matematikai társprocesszorok felbukkanása, a GPU-k térnyerése, majd a többmagos CPU-k általánossá válása is.

Most egy újabb, hasonló korszakhatárhoz érkeztünk, csak ezúttal a változás motorja nem a grafika, nem is a hagyományos alkalmazás-teljesítmény, hanem a mesterséges intelligencia. Az AI immár nem kizárólag adatközpontok és felhőszolgáltatások privilégiuma: fokozatosan beköltözik az otthoni számítógépbe, és ezzel együtt egy új szereplő lép porondra az otthoni PC-k színpadán, az NPU, vagyis a neurális feldolgozóegység. A CPU, a GPU és az NPU együttese immáron a jelen, a modern AI-képes PC alapképlete, és bár a gyártók kommunikációjában sokszor minden a TOPs-értékek körül forog, a valóság ennél jóval árnyaltabb és összetettebb.

AI-vezérelt chipevolúció

A hagyományos számítástechnika hosszú időn át a CPU-ra épült. A központi processzor sokoldalú, rugalmas, bonyolult vezérlési logikára képes egység, amely kiválóan alkalmas operációs rendszerek, általános szoftverek, irodai alkalmazások és minden olyan feladat futtatására, ahol változatos utasítássorozatokat, elágazásokat és összetett döntési folyamatokat kell kezelni.

A mesterséges intelligencia, pontosabban a modern neurális hálózatok azonban egészen más jellegű terhelést rónak a hardverre. Itt nem elsősorban logikai összetettségre, hanem hatalmas mennyiségű ismétlődő matematikai műveletre van szükség, mindenekelőtt mátrixszorzásokra és összeadásokra. Ez a feladattípus a processzorok számára nem ideális terep, hiszen nem arra tervezték, hogy ezrével vagy tízezrével hajtson végre azonos műveleteket tökéletesen párhuzamosítva.

Éppen ezért az AI-korszak első nagy hardveres nyertese a GPU lett. A grafikus processzorokat eredetileg képi megjelenítésre fejlesztették, ahol a rendszernek egyszerre rengeteg hasonló műveletet kell elvégeznie pixeleken, vertexeken és textúraadatokon. Ez a masszívan párhuzamos felépítés gyakorlatilag ideálissá tette a GPU-kat a neurális hálózatok számára is.

A deep learning forradalom elképzelhetetlen lett volna a grafikus processzorok nélkül, és a mai napig ezek jelentik a mesterséges intelligencia betanításának és a komolyabb generatív modellek futtatásának alapját. Ugyanakkor a GPU egy univerzális párhuzamos gyorsító, nem pedig kifejezetten neurális hálózatokra optimalizált célhardver. Éppen ez a rugalmasság jár azzal, hogy a GPU energiafogyasztása és hőtermelése magasabb, ezért a folyamatosan futó, alacsony késleltetésű AI-funkciók kiszolgálására például egy hordozható gépben nem ez a leghatékonyabb megoldás.

Innen nézve az NPU megjelenése kifejezetten logikus lépés. A neurális feldolgozóegység nem általános célú gyorsítóként működik, hanem egyetlen feladatra optimalizálták: neurális hálózatok hatékony futtatására. Ez a specializáció azzal jár, hogy az NPU kevésbé rugalmas, mint egy GPU, viszont jelentősen kisebb energiafelhasználással képes elvégezni ugyanazokat a következtetési feladatokat. Vagyis nem feltétlenül abban jobb, hogy minden helyzetben gyorsabb, hanem abban, hogy ugyanazt a munkát töredéknyi fogyasztással, kisebb hőtermelés mellett és kisebb rendszerterheléssel végzi el. Egy modern laptop esetében ez legalább akkora előny, mint a nyers számítási teljesítmény.

TOPs: mérőszám vagy marketing?

Az NPU-k körüli kommunikáció középpontjában jelenleg a TOPs áll, vagyis a trillions of operations per second mérőszám. Ez első ránézésre egyszerű és jól értelmezhető mutatónak tűnik: minél nagyobb, annál erősebb a hardver. A valóság azonban ennél összetettebb. Egy AI-gyorsító teljesítménye ugyanis erősen függ attól, hogy milyen pontosságú számításról beszélünk. A modellek betanítása jellemzően nagyobb precizitást igényel, ezért a gyakorlatban leginkább FP16/BF16-alapú, vegyes pontosságú számítások futnak, míg a következtetés során gyakori az INT8, sőt egyes esetekben az INT4 használata is. Minél alacsonyabb a pontosság, annál több művelet hajtható végre adott idő alatt, vagyis annál magasabb TOPs-érték kommunikálható. Emiatt két hasonló, például 45-50 TOPs-os NPU között valós használatban jelentős különbségek lehetnek attól függően, hogy ezt az értéket milyen adattípuson és milyen architekturális feltételek mellett érték el.

A helyzetet tovább árnyalja az ún. dense és sparse TOPs megkülönböztetése. Bizonyos modellek és optimalizációs eljárások esetén a súlymátrixok részben ritkák lehetnek, és egyes gyorsítók képesek ezeket a nullás műveleteket kihagyni. Ez papíron magasabb teljesítményt eredményezhet, a gyakorlatban azonban erősen függ a konkrét modelltől és a szoftver implementációjától. Emiatt a TOPs inkább kiindulási pont, mint végső mérőszám. A valós teljesítményt legalább ennyire befolyásolja a memóriaelérés módja, a támogatott numerikus formátumok köre, valamint a szoftveres ökoszisztéma érettsége.

Hol számít igazán az NPU a gyakorlatban?

Az NPU legnagyobb előnye az otthoni PC-kben nem látványos benchmarkokban, hanem a felhasználói élményben jelenik meg. A videóhívások során futó zajszűrés, háttérelmosás vagy szemkontaktus-korrekció tipikusan olyan feladat, amelyet GPU-val is meg lehet oldani, de az NPU ezt jóval kisebb fogyasztással képes kezelni. Ugyanez igaz az élő feliratozásra, a valós idejű fordításra vagy a helyi keresési és indexelési funkciókra. A Copilot+ PC-k esetében ezek a képességek már a rendszer szintjén jelennek meg, ugyanakkor fontos kiemelni, hogy az ilyen AI-funkciók futtatása nem kizárólag az NPU-ra épül: a Windows AI-alrendszere az adott alkalmazás optimalizáltságától és a terhelés jellegétől függően osztja el a feladatokat a CPU, a GPU és az NPU között.

Ez az oka annak is, hogy a Copilot+ PC kategóriában a Microsoft minimum 40 TOPs-os NPU-t határozott meg. Ez a teljesítményszint nem általános AI-erősséget jelent, hanem azt a küszöböt, ahol bizonyos helyben futó AI-funkciók már folyamatos, használható élményt biztosítanak.

Az NPU tehát nem a GPU leváltására érkezett, hanem arra, hogy átvegye azokat az ismétlődő, alacsony késleltetést igénylő inferencia-feladatokat, amelyek korábban feleslegesen terhelték a rendszer többi komponensét.

GPU vs. NPU - nem verseny, szereposztás

Mindebből természetesen nem következik, hogy a GPU szerepe csökkenne. A diszkrét videokártyák továbbra is megkerülhetetlenek minden olyan területen, ahol nagy számítási teljesítményre és jelentős memória-sávszélességre van szükség. A modellek betanítása, finomhangolása, a generatív képi és videós munkafolyamatok, valamint a nagy nyelvi modellek futtatása továbbra is elsősorban a GPU feladata marad. Ebben a környezetben különösen fontos szerepet kap a VRAM, hiszen gyakran nem a számítási kapacitás, hanem a memória jelenti a szűk keresztmetszetet.

Ez jól látható például abban az esetben, amikor egy 12 GB memóriával rendelkező GeForce RTX 3060 bizonyos AI-felhasználásoknál előnyösebb választás lehet, mint egy 8 GB-os RTX 4060. A nagyobb modellek, komplexebb Stable Diffusion munkafolyamatok vagy több LoRA egyidejű használata esetén a memória kapacitása sokszor fontosabb, mint a nyers számítási teljesítmény. Ugyanakkor érdemes hangsúlyozni, hogy ez a fölény elsősorban a nagy modellekre és komplex feladatokra igaz, míg kisebb, kvantált inferencia esetén az NPU vagy akár integrált megoldások is versenyképesek lehetnek energiahatékonyságban.

A kvantálás egyébként is kulcsszerepet játszik. A modellek tömörítése lehetővé teszi, hogy azok kevesebb memórián és alacsonyabb pontosság mellett is futtathatók legyenek. Elméleti szinten egy FP16-os modell paraméterenként két Byte-ot igényel, míg INT8 esetén ez egy Byte-ra, INT4 esetén pedig elméletben fél Byte körüli értékre csökken. A valós futtatás során azonban a teljes memóriaigény ennél nagyobb lehet, mivel az aktivációk, gyorsítótárazott adatok és egyéb adatszerkezetek is helyet igényelnek. Ennek ellenére a kvantálás teszi lehetővé, hogy egyes AI-modellek már fogyasztói laptopokon is helyben fussanak, felhőkapcsolat nélkül.

Három gyártó, három megközelítés

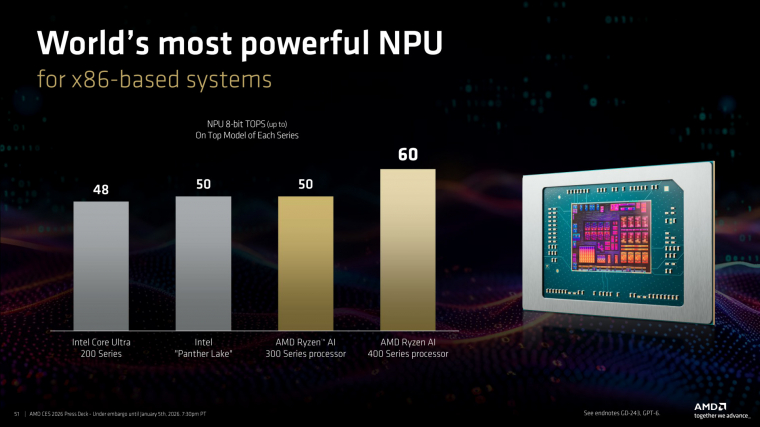

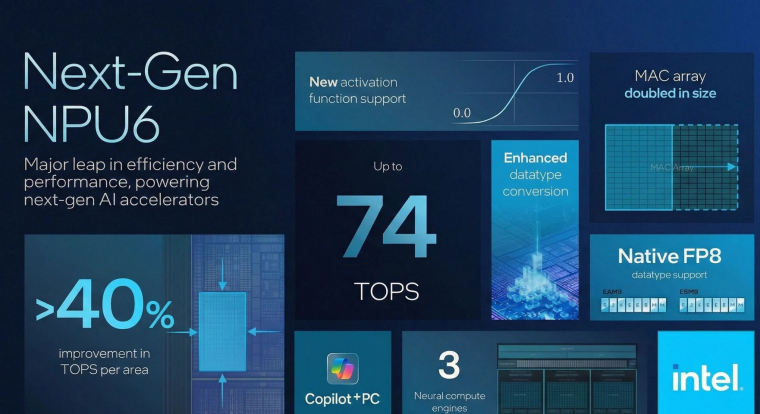

A gyártók eltérő stratégiával közelítik meg ezt az új részegységet. Az Intel a Lunar Lake generációval jelentős előrelépést tett, az NPU 4 már 48 TOPs teljesítményt kínál, miközben az OpenVINO ökoszisztéma révén erős fejlesztői támogatást biztosít. Az AMD az XDNA architektúrával, a Xilinx örökségére építve rugalmas, neurális feladatokra optimalizált feldolgozási blokkokat biztosít, amelyek a Ryzen AI platformban integráltan működnek együtt a CPU-val és a GPU-val. A Qualcomm Snapdragon X Elite és az arra épülő X-sorozat többi tagja pedig a mobilos hatékonyságot hozza át a PC-k világába, különösen hosszú akkumulátoros üzemidővel és célzott AI-optimalizációval.

A szintetikus tesztek, például a Geekbench AI vagy a Procyon jól mutatják, hogy a különböző architektúrák eltérő pontossági szinteken teljesítenek kiemelkedően. A GPU-k általában erősek nagyobb precizitás mellett, míg az NPU-k a kvantált inferenciában mutatják meg valódi előnyüket. A valós felhasználás során azonban még ennél is fontosabb a szoftveres optimalizáció. Ha egy alkalmazást kifejezetten NPU-ra fejlesztenek, akkor a gyorsulás jelentős lehet, ellenkező esetben viszont a GPU marad a domináns végrehajtó chip.

A háttérben mindezt ugyanaz a matematikai alapelv hajtja. A neurális hálózatok működése nagyrészt mátrixműveletekre épül, és a teljesítmény kulcsa az, hogy ezeket a műveleteket mennyire hatékonyan képes végrehajtani az adott architektúra. A GPU ezt tömeges párhuzamosítás révén éri el, míg az NPU gyakran úgy optimalizál, hogy minimalizálja az adatmozgatást, elsősorban nagy mennyiségű on-chip memóriatárra és adatfolyam-alapú feldolgozásra támaszkodva, és a számítást célzott adatfolyamként szervezi meg. Ez a különbség jól mutatja a két megközelítés lényegét: a GPU egy univerzális, nagy teljesítményű gyorsító, míg az NPU egy specializált, rendkívül hatékony egység.

A jövő PC-je egy együttműködő architektúra

Az otthoni PC jövője ezért nem az NPU vagy a GPU kizárólagosságáról szól, hanem a kettő - pontosabban a CPU-val három - együttműködéséről. A háttérben futó, valós idejű AI-funkciókat az NPU kezeli, a nagy számításigényű feladatokat a GPU végzi, míg a CPU a rendszer működését koordinálja. A felhasználó mindebből annyit érzékel majd, hogy a számítógépe gyorsabban reagál, több feladatot képes helyben elvégezni, kevésbé melegszik és hatékonyabban gazdálkodik az energiával.

A TOPs-korszak tehát valóban elérkezett, de nem egyetlen számról szól. Sokkal inkább arról, hogy a PC-architektúra újra specializálódik, és a mesterséges intelligencia a hardver szintjén válik a rendszer részévé. Az NPU nem a GPU utódja, hanem annak kiegészítője, és együtt egy olyan új működési modellt hoznak létre, amely hosszú távon alapjaiban formálja át a személyi számítógépek szerepét.